La demanda imparable de potencia de procesamiento de IA

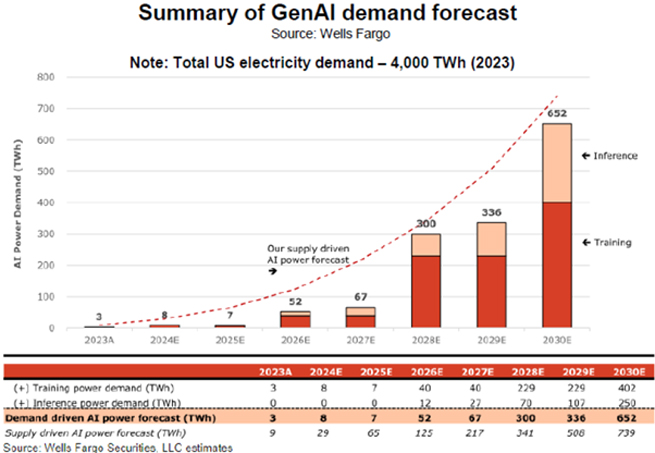

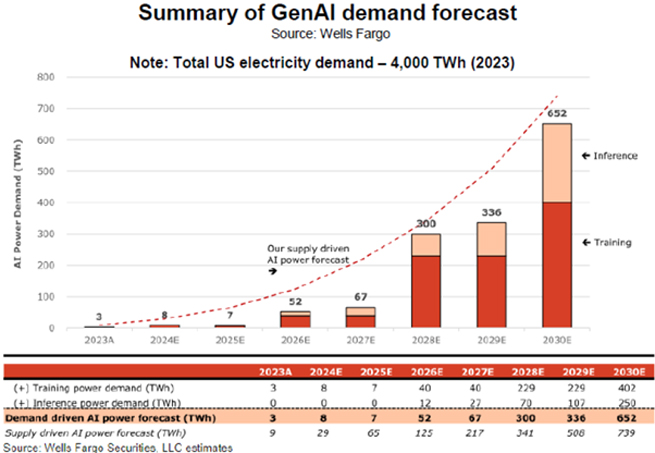

La inteligencia artificial (IA) está transformando industrias en todo el mundo, desde la atención médica y las finanzas hasta la fabricación y el entretenimiento. Pero con la rápida evolución de la IA viene una demanda insaciable de potencia informática. De hecho, esta demanda se duplica aproximadamente cada 100 días, creando un cambio sísmico en la forma en que construimos y mantenemos los centros de datos. A medida que las tecnologías de inteligencia artificial se vuelven cada vez más sofisticadas, la infraestructura que las respalda debe escalar en consecuencia para satisfacer las crecientes necesidades de potencia de procesamiento, almacenamiento y velocidad.

Los centros de datos son la columna vertebral de la innovación de la IA. Pero la gran escala y complejidad de estos centros presentan desafíos importantes. Desde chips y GPU de vanguardia hasta sistemas de software avanzados y componentes de red, cada elemento de la infraestructura del centro de datos debe optimizarse para garantizar un servicio fluido e ininterrumpido. Y, a medida que la IA continúa expandiéndose, las apuestas para los proveedores de servicios nunca han sido más altas.

El desafío de la infraestructura de IA: por qué importan los centros de datos

En el corazón de cada sistema de inteligencia artificial se encuentra una red masiva e interconectada de hardware y software que realiza cálculos complejos. La formación de modelos de lenguaje grande (LLM) y el soporte de aplicaciones de IA generativas requieren una inmensa cantidad de potencia computacional, mucho más allá de lo que pueden manejar los sistemas informáticos tradicionales. A medida que las aplicaciones de IA se vuelven más poderosas, se intensifica la necesidad de infraestructura avanzada.

Tomemos, por ejemplo, los comentarios de Sam Altman sobre las luchas de OpenAI con una "falta de GPU" a medida que la compañía lanza sus últimos modelos. Además, Goldman Sachs pronostica que AI impulsará un 165% aumento en el consumo de electricidad de los centros de datos para 2030. Esto coloca la infraestructura a la vanguardia de la revolución de la inteligencia artificial, con empresas que luchan por construir centros de datos escalables y energéticamente eficientes capaces de respaldar las próximas iteraciones de IA.

Baches en el camino: el dilema que escala

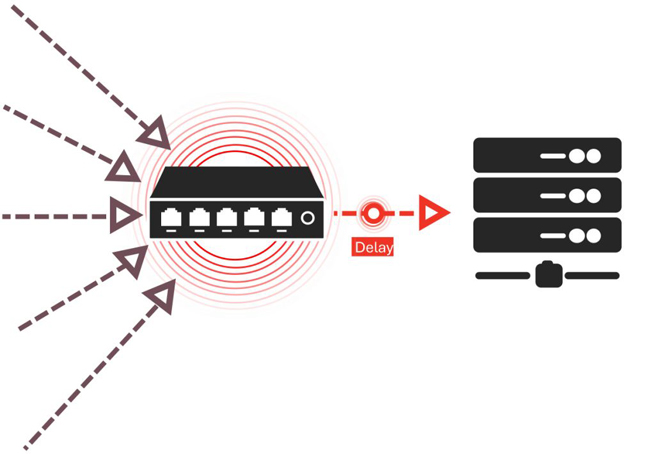

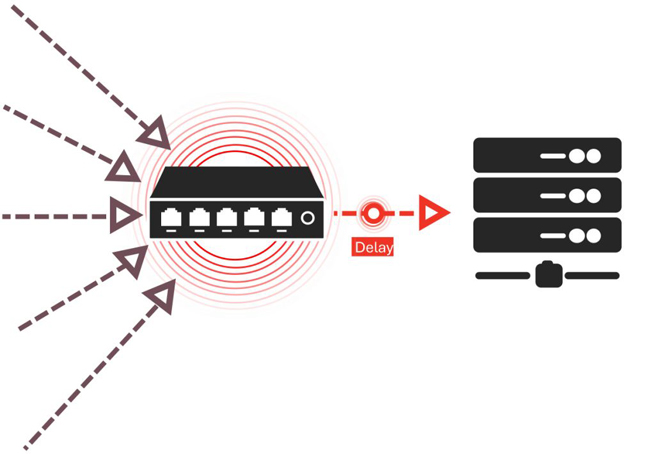

Escalar la infraestructura de IA no es tarea fácil. Las cargas de trabajo de IA imponen demandas sin precedentes en los centros de datos, lo que les exige no solo una mayor potencia de procesamiento, sino también una memoria y un ancho de banda más rápidos, así como soluciones de refrigeración más eficientes. Los clústeres de IA distribuidos, que se utilizan para distribuir tareas entre las GPU, son particularmente susceptibles a los cuellos de botella de rendimiento debido a la latencia de la cola (el retraso introducido por los componentes más lentos de un sistema). Si no se abordan estos cuellos de botella, incluso el hardware más avanzado tendrá dificultades para satisfacer las necesidades de procesamiento de IA en tiempo real.

Simplemente cumplir con los estándares de la industria ya no es suficiente. Los componentes del centro de datos deben probarse rigurosamente, tanto a nivel individual como en la capa de red, para garantizar que puedan manejar las inmensas cargas de procesamiento y transferencia de datos. Por ejemplo, un transceptor que cumpla con los estándares de la industria podría fallar en condiciones del mundo real si no ha sido probado adecuadamente para el protocolo de red y la corrección de errores hacia adelante.

El papel de las pruebas: garantizar la confiabilidad de la infraestructura de Inteligencia Artificial

Para escalar la infraestructura de inteligencia artificial de manera eficiente, es fundamental realizar pruebas rigurosas. Mediante el uso de simuladores a nivel de sistema que replican las complejidades de las cargas de trabajo de IA, los proveedores de servicios pueden validar, optimizar y mejorar el rendimiento en todos los componentes del centro de datos. Esto incluye evaluar todo, desde chips y servidores hasta componentes de red y software. Las pruebas integrales ayudan a identificar ineficiencias, optimizar la asignación de recursos y garantizar que el sistema permanezca robusto incluso bajo las cargas máximas.

1. Rendimiento de los componentes: AI exige hardware especializado que pueda ofrecer una potencia de procesamiento extrema. Los chips dedicados, como el último superchip de NVIDIA, ofrecen hasta 30 veces el rendimiento de los procesadores convencionales y reducen el consumo de energía en 25 veces. Pero estos avances en el hardware requieren pruebas intensivas para garantizar que el sistema pueda manejar cargas máximas y ofrecer un rendimiento constante en todos los componentes.

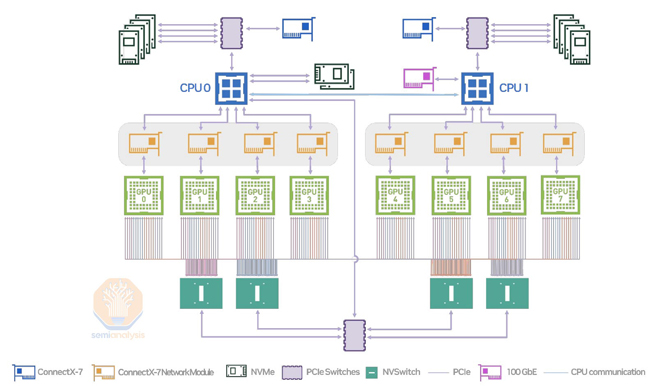

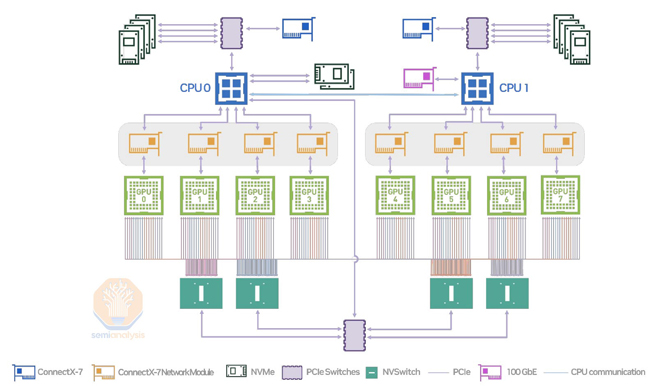

2. Redes y ancho de banda: la arquitectura de interconexión de un centro de datos juega un papel vital en el rendimiento de la IA. La Validación de red ayuda a prevenir los cuellos de botella al garantizar que la infraestructura de red admita las demandas de alta velocidad y baja latencia de las aplicaciones de inteligencia artificial. Esto incluye evaluar las capacidades de ancho de banda de las conexiones de fibra, optimizar las arquitecturas de memoria y probar los sistemas de almacenamiento para garantizar un acceso rápido a los datos.

3. Cargas de trabajo del mundo real y asignación dinámica de recursos: las cargas de trabajo de IA son dinámicas y a menudo impredecibles, lo que requiere una arquitectura flexible y eficiente que pueda manejar demandas fluctuantes. Las pruebas de estrés y la evaluación comparativa en condiciones del mundo real son esenciales para identificar problemas potenciales, como la latencia de la cola, que podrían obstaculizar el rendimiento. Además, la capacidad de asignar dinámicamente recursos, como la memoria y la potencia de procesamiento, garantiza que los centros de datos puedan escalar en tiempo real para satisfacer las demandas cambiantes de las cargas de trabajo de IA.

Avanzando el hardware y el software: lograr un rendimiento máximo

A medida que las cargas de trabajo de IA crecen en complejidad, la infraestructura que las respalda debe evolucionar. El hardware dedicado y el software inteligente son clave para brindar el rendimiento y la eficiencia requeridos por los sistemas de inteligencia artificial de próxima generación.

Hardware de IA dedicado: además de los superchips, las cargas de trabajo de IA requieren módulos de memoria de alto rendimiento, tarjetas de inferencia de red y conmutadores optimizados. Cada uno de estos componentes debe evaluarse de forma aislada y como parte del sistema más amplio para garantizar que toda la red pueda manejar las demandas máximas de las aplicaciones de IA.

Software y gestión inteligente: más allá del hardware, la optimización de software juega un papel crucial en la infraestructura de inteligencia artificial. Los algoritmos avanzados para la asignación dinámica de recursos, el autoescalado y el equilibrio de carga son esenciales para maximizar la eficiencia. Las herramientas de simulación y modelado pueden ayudar a los operadores de centros de datos a comparar la arquitectura y el rendimiento de la red para garantizar que el sistema pueda ajustarse dinámicamente a las diferentes cargas de trabajo.

Fiabilidad y Optimización: el camino hacia adelante

A medida que la IA continúa impulsando un crecimiento exponencial en las necesidades informáticas, los centros de datos deben evolucionar rápidamente para mantenerse al día. Los sistemas y componentes que alimentan la infraestructura de Inteligencia Artificial deben probarse rigurosamente para identificar ineficiencias, optimizar el rendimiento y garantizar la confiabilidad a largo plazo.

Los proveedores de servicios que pueden integrar técnicas integrales de prueba, validación y optimización estarán mejor posicionados para respaldar el crecimiento futuro de la IA. Esto incluye pruebas de resistencia de hardware, ajuste de la arquitectura de red y administración dinámica de recursos en función de la demanda en tiempo real. Con una cuidadosa atención a estos factores, los centros de datos pueden escalar de manera eficiente, cumplir con los objetivos de rendimiento y permanecer resistentes a medida que la IA continúa revolucionando las industrias en todo el mundo.

Por Jennifer Tseng

Hi, I'm Jennifer, Marketing Executive at lanaotek.com.

I specialize in translating cutting-edge optical and Ethernet transmission technologies into clear, valuable insights that help our customers stay ahead in a fast-evolving digital world.

By turning complex technical concepts into practical, business-driven content, I aim to empower decision-makers with the knowledge they need to make confident, future-ready choices.

Centro DE DATOS DE Internet

Centro DE DATOS DE Internet Preguntas frecuentes

Preguntas frecuentes Noticias de la industria

Noticias de la industria Acerca de nosotros

Acerca de nosotros Interruptor del centro de datos

Interruptor del centro de datos  Conmutador de empresa

Conmutador de empresa  Interruptor industrial

Interruptor industrial  Interruptor de acceso

Interruptor de acceso  Red integrada

Red integrada  Módulo óptico y cable

Módulo óptico y cable

Llámanos:

Llámanos:  Envíenos un correo electrónico:

Envíenos un correo electrónico:  2106B, # 3D, Cloud Park Fase 1, Bantian, Longgang, Shenzhen, 518129, P.R.C.

2106B, # 3D, Cloud Park Fase 1, Bantian, Longgang, Shenzhen, 518129, P.R.C.